焦虑与破局:大模型开发者如何应对智能体工程化浪潮

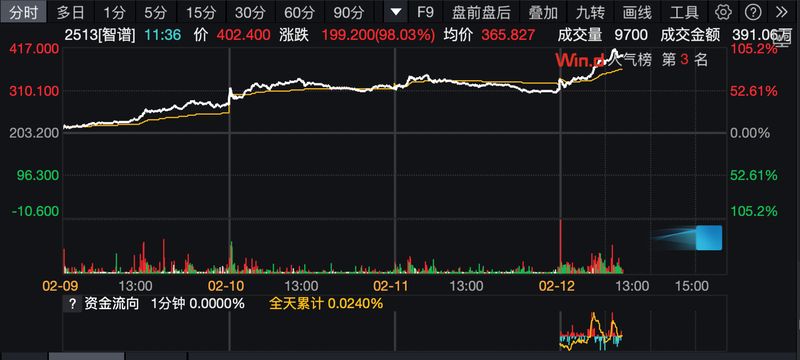

在大模型技术迭代进入“深水区”的当下,开发者普遍面临着从单纯的PromptEngineering转向AgenticEngineering的转型焦虑。智谱GLM-5的发布不仅是资本市场的狂欢,更是技术范式转移的信号。针对这一趋势,开发者需要构建系统化的应对路径。

任务设定:重构工作流逻辑

当前的大模型应用已不再局限于单轮对话,而是向工程化、任务型演进。第一步,开发者应审视现有业务流程中,哪些环节属于“长程交互”。以GLM-5为例,其在处理复杂系统工程时表现出的SOTA水平,提示我们必须将智能体(Agent)视为核心组件,而非简单的API调用。务必将代码生成与端到端应用开发解耦,利用模型在长文本和复杂逻辑推理上的优势,构建可自动规划任务路径的Agent体系。

步骤分解:从模型选型到部署优化

第二步,执行层面的技术选型至关重要。开发者需关注模型架构的演进方向。例如,GLM-5集成的DeepSeekSparseAttention机制,标志着在维持长文本处理能力的同时,部署成本将大幅降低。建议在项目初期,优先评估模型在推理效率(如FP8精度支持)与多模态融合方面的表现,而非单纯追求参数规模。

执行要点:强化长程交互学习

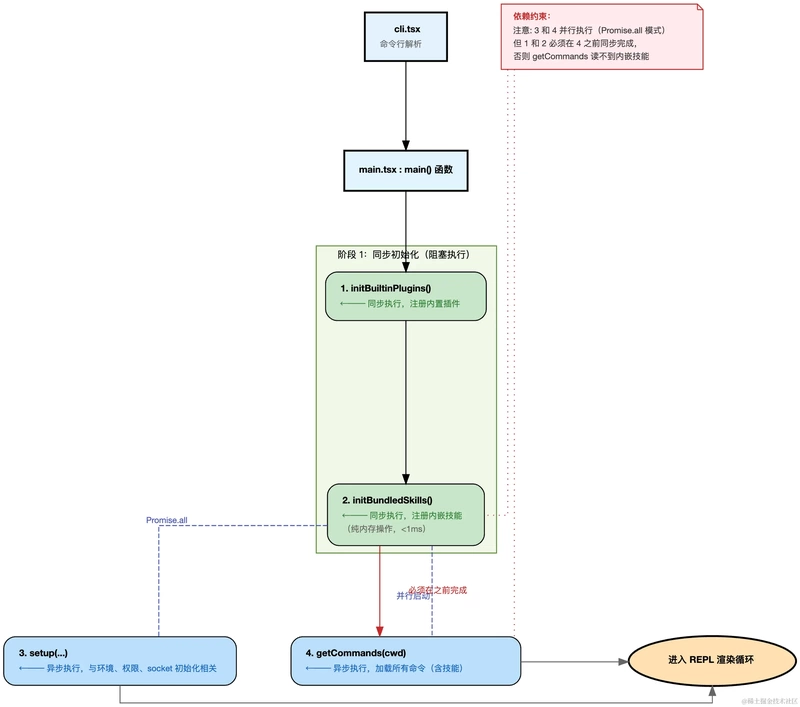

第三步,核心能力的落地。GLM-5通过异步智能体强化学习算法,实现了持续学习。这意味着开发者在构建Agent时,必须设计一套有效的反馈闭环机制,让Agent能够在交互中自我迭代。在实践中,利用OpenClaw等开源框架接入模型,可以显著降低从原型到生产环境的迁移成本,实现定时整理、自动编程等全流程自动化。

常见问题:算力成本与性能瓶颈

第四步,规避常见陷阱。许多团队在部署时常因忽视稀疏注意力机制而导致高昂的调用成本。针对此类问题,应优先采用适配主流推理框架的模型,并对上下文窗口(ContextWindow)进行精细化管理。针对DeepSeek等模型支持的百万级Token长度,需建立与之匹配的数据预处理管道,防止无效信息稀释模型推理质量。

进阶优化:构建行业壁垒

第五步,进阶策略。通过深度集成AgenticEngineering,将通用模型能力转化为特定垂直领域的深度应用。在模型选择上,关注各大厂商如阿里Qwen3-Coder-Next、MiniMax-M2.5等在特定领域的性能表现,构建异构模型集群,以应对不同复杂度的业务需求。