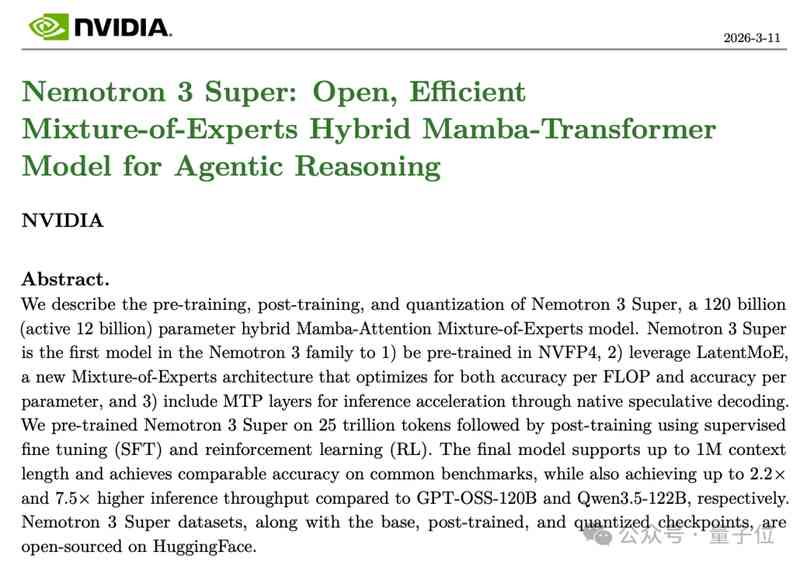

260亿美元开源算力布局:英伟达Nemotron3Super模型的技术解构

人工智能领域的技术演进正处于算力与架构深度融合的关键节点。近期,英伟达发布了Nemotron3Super这一开源MoE模型,并宣布未来五年内投入260亿美元用于开源AI模型的研发与基础设施构建。这一举措标志着算力巨头正式将战略重心向开源生态倾斜,旨在通过软硬件协同优化,重塑智能体在复杂环境下的推理能力。

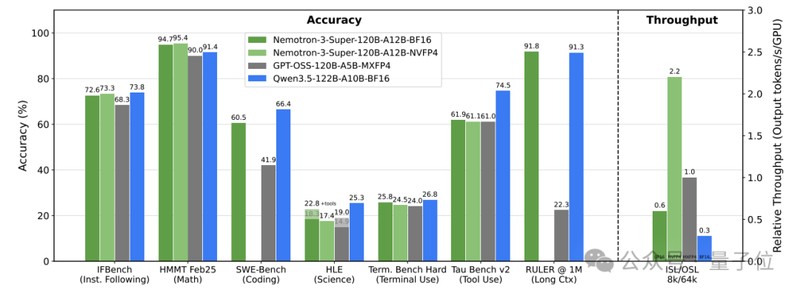

性能突破与数据基准

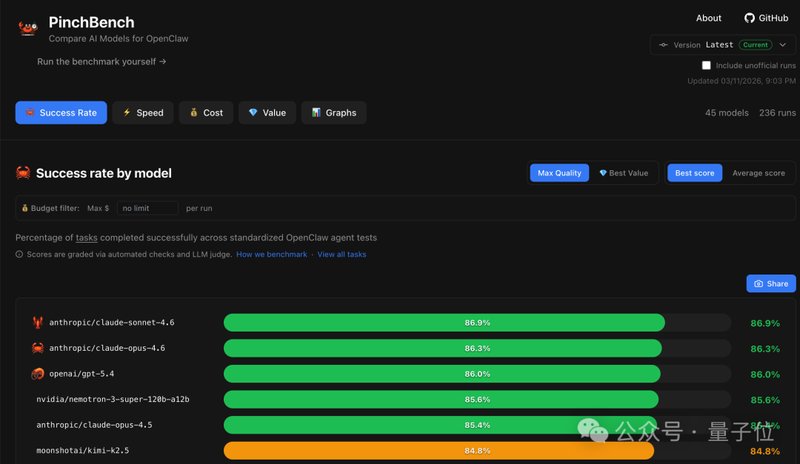

Nemotron3Super模型采用了120B参数规模的混合专家架构,在多项核心基准测试中展现出显著的性能优势。在PinchBench测试中,该模型以85.6%的得分位居同类开源模型榜首,并在ArtificialIntelligenceIndex中取得37分,超越了传统基准模型。在软件工程基准SWE-Bench中,搭配OpenHands框架实现了60.47%的准确率,证明了其在代码攻坚与复杂逻辑推理任务中的稳健表现。此外,在MMLU-Pro测试中,83.73分的成绩进一步印证了其在常识推理维度的进化。

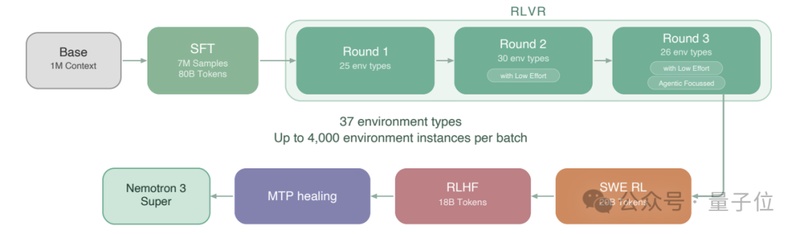

架构创新下的推理效率

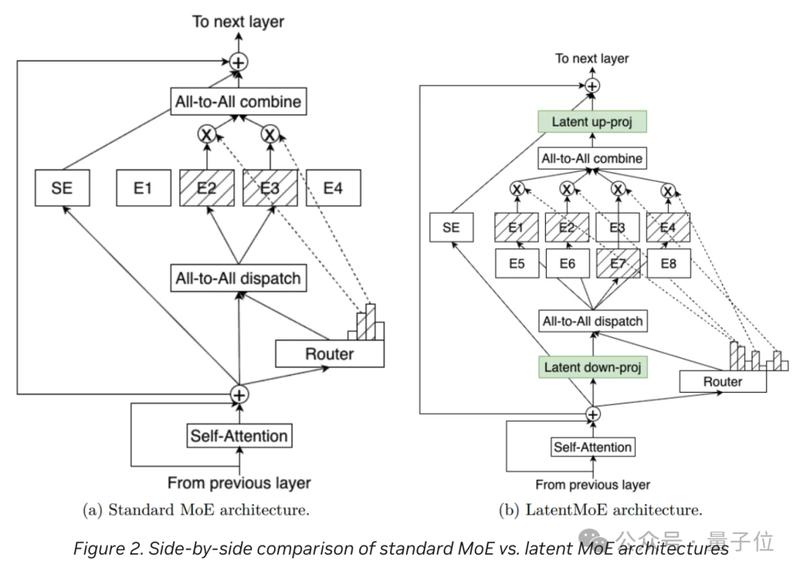

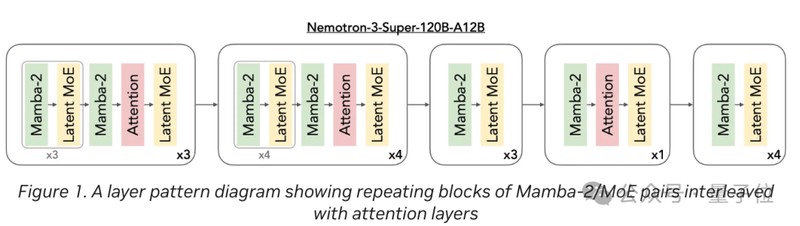

模型性能的跨越式提升源于架构层面的深层优化。Nemotron3Super原生支持100万token的上下文窗口,为智能体提供了广阔的长期记忆空间。为了在处理海量信息时兼顾精度与速度,研发团队引入了混合Mamba-Transformer架构。这种设计交织使用了具备线性时间复杂度的Mamba-2层处理长序列任务,并保留Transformer全局注意力层以确保信息关联的准确性。同时,LatentMoE架构通过在低秩潜空间进行降维处理,使模型能够在维持推理成本不变的前提下,调用四倍数量的专家网络,实现了精细化的专业分工。

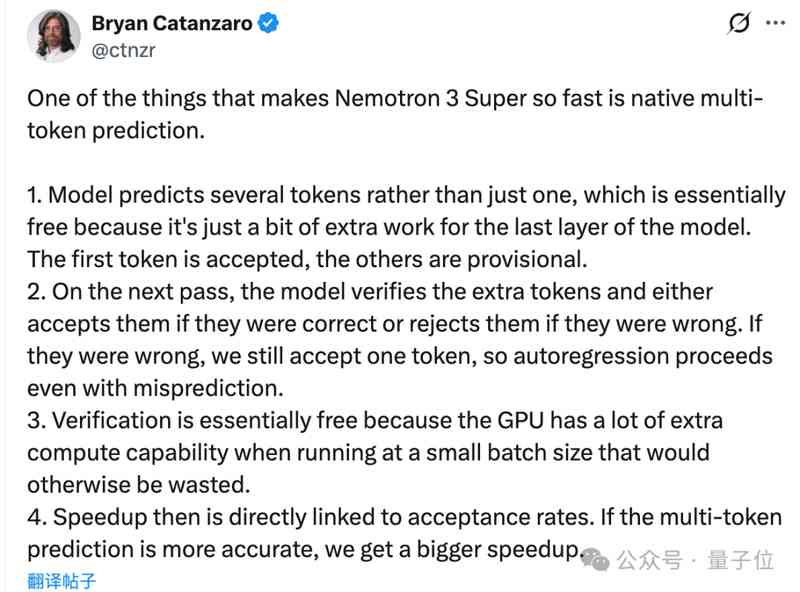

硬件协同的深层演进

除了软件算法的创新,该模型在硬件适配上也进行了根本性革新。通过原生NVFP4格式进行预训练,模型从起步阶段便完全契合Blackwell架构的算力特性,在B200芯片上实现了推理速度的大幅提升。此外,多token预测技术的应用,通过共享权重设计并行预测未来token,显著缩短了生成耗时。这种软硬件一体化的路径,不仅提升了实时响应速度,更为未来构建基于真实业务场景的Agent生态奠定了坚实的底层逻辑支撑。